|

|

|

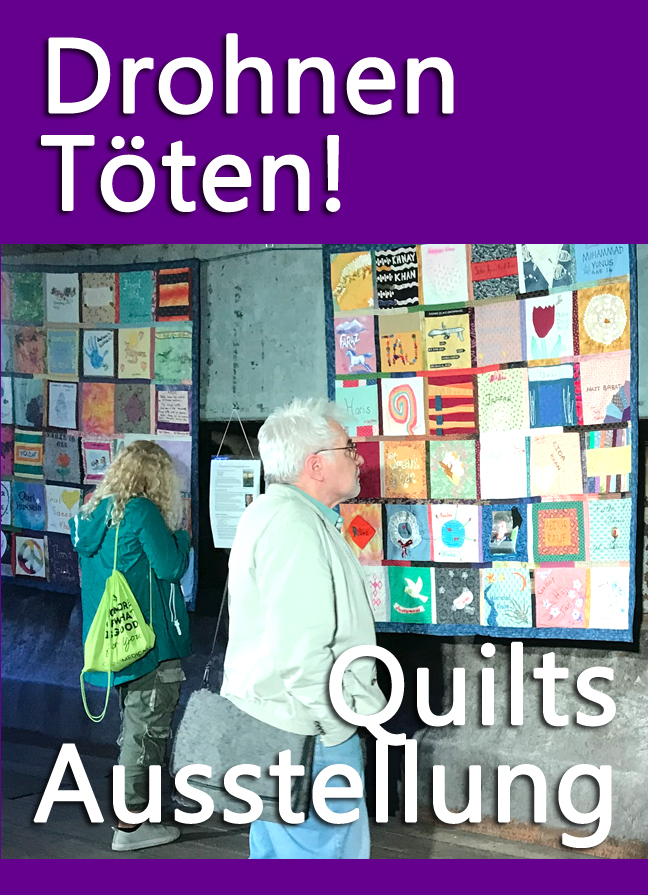

Polizei-Frosch im EinsatzDer Fortschritt ist scheinbar nicht aufzuhalten - auch wenn er den größten Unsinn erzeugt. So werden in den USA immer mehr Polizeiberichte automatisch nach den Bodycam Aufnahmen der Polizeikräfte geschrieben. Und das passiert immer öfter nicht von den vor Ort beteiligten Polizisten, sondern von Bürokräften und neuerdings auch von der KI-gestützten Software Draft One. False PositivesDie berühmt-berüchtigten "falsch Verdächtigten" verfolgen uns seit Bestehen des Vereins vor 17 Jahren. Sie werden durch falsch interpretierte Beweismittel, wie Überwachungssoftware, Gesichtserkennung usw dazu gezwungen ihre Unschuld selbst beweisen zu müssen, da für sie die Unschuldsvermutung plötzlich nicht mehr gilt. Das betrifft nun auch die Polizei von Heber City im US-Bundesstaat Utah. Dort wurde in einem offiziellen Bericht - der KI-gestützten Software Draft One - behauptet, ein Beamter habe sich in einen Frosch verwandelt. Das führte nicht nur für den genannten Beamten zu Problemen. Der in Salt Lake City ansässige Sender Fox 13 berichtete über den Fall und fragte daraufhin bei der Polizeibehörde nach. An unserer Stelle hätten wir uns nicht mit der offiziellen Erklärung zufrieden gegeben: In der Bodycam Aufnahme lief im Hintergrund auf einem Fernseher der Disney Film "Der Froschkönig". Die notwendige Forderung nach solcher Erkenntnis heißt mindestens: Verschrottung von Draft One - KI darf niemals ohne menschliche Überprüfung Polizeiberichte verfassen! KritikerInnen warnen laut t3n.de, dass KI-gestützte Systeme bestehende rassistische oder geschlechtsspezifische Vorurteile verstärken könnten. Studien haben belegt, dass generative KI-Modelle dazu neigen, Diskriminierungen gegenüber Frauen und nicht-weißen Personen zu reproduzieren. Auch dass in den berichten nicht unterscheidbar ist, welche Teile KI-generiert und welche von Menschen stammen, sei ein eklatanter Verstoß für spätere darauf beruhende rechtliche Verfahren. Mehr dazu bei https://t3n.de/news/ki-panne-bei-us-polizei-software-verwandelt-beamten-in-frosch-1723893/ Kategorie[21]: Unsere Themen in der Presse Short-Link dieser Seite: a-fsa.de/d/3MS Link zu dieser Seite: https://www.a-fsa.de/de/articles/9430-20260205-halluzinierende-ki.html Link im Tor-Netzwerk: http://a6pdp5vmmw4zm5tifrc3qo2pyz7mvnk4zzimpesnckvzinubzmioddad.onion/de/articles/9430-20260205-halluzinierende-ki.html Tags: #AI #KI #FalsePositives #Polizei #Bodycams #Transparenz #Informationsfreiheit #Gender #Diskriminierung #Ungleichbehandlung #Unschuldsvermutung #Verhaltensänderung #Beweisumkehr #Persönlichkeitsrecht Erstellt: 2026-02-05 09:19:06 Aufrufe: 418 Kommentar abgeben |

CC Lizenz Mitglied im European Civil Liberties Network Bundesfreiwilligendienst Wir speichern nicht World Beyond War Kein Java Transparenz in der Zivilgesellschaft

|

|

|

|

|

|

|

|

|